El impacto de la tecnología de deepfake en las campañas electorales es una preocupación creciente en todo el mundo. A medida que nos acercamos a las elecciones presidenciales de 2023 en Argentina, es importante considerar cómo esta tecnología podría influir en el resultado de la elección y cómo podemos prevenirla.

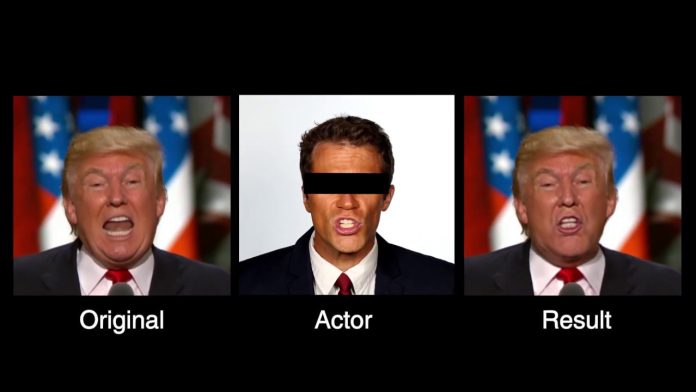

Para aquellos que no están tema con el significado, el deepfake es una técnica de inteligencia artificial que se utiliza para crear contenido de audio y video falso que parece auténtico. Ya no se trata de alterar fotos o audios sino de un nivel mucho mas complejo que muchos no conciben siquiera posible. Los deepfakes se han utilizado para crear videos manipulados de políticos y otras figuras públicas diciendo o haciendo cosas que nunca hicieron en realidad. Estos videos falsos pueden ser extremadamente efectivos para difundir información errónea y manipular la opinión pública.

Aunque los deepfakes aún no han sido ampliamente utilizados en campañas políticas en Argentina, ha habido varios casos notables en otros países. En 2019, un deepfake del presidente estadounidense Barack Obama fue utilizado en un video manipulado para hacer parecer que estaba diciendo cosas que nunca dijo. En la elección presidencial de Brasil en 2018, hubo varios casos de videos falsos que se compartieron ampliamente en las redes sociales para influir en el resultado de la elección.

La amenaza de deepfake es muy real, y los políticos y los partidos políticos deben tomar medidas para prevenirla. Una forma de hacerlo es educar a los votantes sobre la existencia de deepfakes y cómo detectarlos. También es importante que los políticos y los partidos políticos monitoreen de cerca la actividad en línea y las redes sociales para detectar cualquier intento de difundir información falsa.

¿Se imaginan un audio con una voz diseñada por deepfake de Javier Milei que se viralice por WhatsApp hablando que todo lo que dice es un mentira impracticable y subestimando a sus votantes? Aunque también es cierto que Milei no necesita de deepfakes para decir barbaridades.

En la serie “The Capture”

Hay una serie llamada “The Capture” donde en la segunda temporada aborda el impacto de deepfakes en campañas electorales y la gestión de gobierno. En ella un Ministro de Gobierno de Reino Unido tiene que tomar una decisión esencial en materia de seguridad y protección de datos, al tener que adjudicarle la instalación de un programa de reconocimiento facial a una empresa extranjera, en este caso China, sabiendo la opinión negativa que genera en las potencias del mundo occidental una decisión que beneficie al gigante asiático y en la opinión pública la utilización de sus datos biométricos. Más allá de las maniobras de lobby que se muestran en post de forzar la decisión a favor de la empresa, se muestran conductas donde el Ministro se declara a favor de adjudicar la contratación a china mediante deepfake de video tiempo real, generando rechazo en la población y opinión pública por medio de manifestaciones y escraches. Es decir de esta manera logran, mediante técnicas de deepfake, imponer una decisión generando una confusión en la población, ya que sería irrisorio que el Ministro diga “no dije eso, es falso” cuando estaba dando la entrevista en vivo. Todo esto lo resuelve demostrando y dando una entrevista en vivo de él mismo y él al lado, es decir uno real y otro generado con técnicas deepfake. Recomiendo que la vean.

Cómo detectar un deepfake de manera visual

El panorama parece completamente vulnerable en un mundo donde las redes sociales se llenan de imágenes alteradas y creíbles, como las del ex presidente Donald Trump siendo arrestado o del Papa Francisco en situaciones insólitas. Sin embargo, dependiendo del nivel de profesionalismo de cada caso, podemos recurrir a analizar varios detalles que se pueden detectar a simple vista y que hay que tener en cuenta (además de observar si la imagen de la otra persona y sus movimientos son naturales):

■ El pelo y la barba: El pelo es una geometría muy difícil de representar, así que los programas que generan los deepfakes difuminan las partes del pelo para disimularlos.

■ Las gafas (si las lleva): Las herramientas de IA generativa son propensas a generar imágenes con gafas incorrectamente ya que generan brillos artificiales que son fácilmente detectables.

■ Pose de la cara: Al ponerse de perfil el sistema puede generar algunas deformaciones en la imagen fácilmente perceptibles.

■ Expresiones faciales: Fijarse en si la persona está actuando de forma natural es crucial, estas redes solo generan imágenes, no saben lo que es una expresión facial.

■ Mirada de la persona: Es muy común encontrarse DeepFakes con la mirada perdida.

■ Pestañeo: Si prestamos atención al pestañeo de la persona, es posible deducir si es un deepfake o no. Estas redes muchas veces hacen videos de pestañeos muy rápidos e incluso a veces casi ni pestañean.

■ Deformaciones de boca, dientes, párpados: Debido a la reducida variabilidad de generación de imágenes, es muy probable que detectemos que el deepfake no vocaliza bien o que sus dientes y brillos en los párpados parezcan muy artificiales.

Regulaciones y concientización

En conclusión, el impacto de deepfake en las campañas electorales es un problema creciente que debemos abordar seriamente. Es importante que los políticos y los partidos políticos en Argentina tomen medidas para prevenir la creación y difusión de deepfakes en las próximas elecciones presidenciales. La educación de los votantes, el monitoreo de la actividad en línea y la regulación pueden ser herramientas útiles para lograr este objetivo. Los países pueden establecer leyes que penalizan la creación y difusión de deepfakes en el contexto de elecciones y políticas.

Sin embargo, la regulación de deepfake es un desafío, ya que los deepfakes no siempre son faciles de detectar y sobre todo rastrear quienes son sus responsables. Precisamente ese es otro de los problemas. A diferencia de las calumnias, que ya Maquiavelo condenaba como practica política, los deepfakes son prácticamente anónimos. Incluso alguien los puede generar como un juego. En cambio su daño e impacto es inmediato. Lo importante es ser conscientes de su existencia y no comprar gato por liebre ni bien nos llegue un video o foto viralizado. Y sobre todo hay que estar alerta en tiempos de grieta. No solo porque habrá muchos de estos deedpfakes sino porque cuando el video que nos llega se encuentra acorde a nuestras emociones y expectativas es muy fácil que “la mente vea lo que elige ver” y lo demos por valido sin exigir siquiera sentido común. Por eso también, antes que nada, la responsabilidad es ciudadana.

¿Valorás nuestro contenido?

Somos un medio de comunicación independiente y tu apoyo económico es fundamental para que que este proyecto sea sostenible y siga creciendo. Hacete socio y construyamos juntos Visión Desarrollista.

,Hacete socio

xx